2026年2月、OpenAIは、AIの悪用を防ぐ取り組みの一環として、中国発とみられる情報操作キャンペーンを阻止した事例を公表しました。

その中には、日本の政治家である高市早苗首相を標的とした、ChatGPTを利用した信用失墜工作が含まれており、国際的にも大きな注目を集めています。

本記事では、この問題の詳細に加え、背景にある情報戦・AI悪用の実態、他国事例、今後のリスクについて深掘りして解説します。

■ OpenAIが公表した「AI悪用の阻止」報告とは?

OpenAIは公式レポート「Disrupting Malicious Uses of AI」において、AIが悪用される具体的なケースを複数公開しました。

その中でも注目されたのが、中国関連の影響工作とされる以下の事例です👇

- 偽情報の生成・拡散

- ロマンス詐欺などの詐欺支援

- 政治的プロパガンダの作成

特に今回のケースでは、ChatGPTを使って政治家への攻撃戦略を設計しようとした点が問題視されています。

■ 高市早苗首相を標的にした6つの攻撃戦略

攻撃者はChatGPTに対し、以下のような体系的な情報操作戦略の作成を依頼していました。

① ネガティブ投稿の拡散

SNS上で首相への否定的な印象を広める投稿の大量生成。

② 移民問題を利用した批判

外国人を装ったメールや意見投稿で政治的圧力を演出。

③ 生活費問題での不満誘導

日本国内の経済問題に結び付けて批判を増幅。

④ 極右レッテル貼り

首相を「軍国主義的」「極右」と印象付ける情報操作。

⑤ 米国関税問題の利用

対米関係への不満を煽り、中国への批判を逸らす。

⑥ 内モンゴル問題の印象操作

内モンゴル自治区に関するポジティブ情報を拡散。

👉これらは典型的な**情報戦(Information Operations)**の手法であり、複数の論点を同時に操作する「多層型プロパガンダ」と呼ばれるものです。

■ ChatGPTはどう対応したのか?

結論から言うと、ChatGPTはこれらの依頼を明確に拒否しました。

OpenAIは以下のような対策を講じています👇

- 政治的影響工作の支援を禁止

- 偽情報生成のリクエストをブロック

- 不審なアカウントの監視と停止

その結果、この攻撃計画はAIによる支援を得られず頓挫しました。

■ AIを使わない形で再試行された工作

興味深い点として、攻撃者はその後👇

- ChatGPTを使わずに作成した文章の「添削」を依頼

- 既存のプロパガンダ文書の改善を試みる

しかし、これも最終的には大きな成果にはつながりませんでした。

■ 実際の影響は?ほぼ「失敗」に終わる

OpenAIの分析によると、このキャンペーンの影響力は極めて限定的でした。

具体的には👇

- YouTube再生数:1桁

- SNSエンゲージメント:ほぼ0

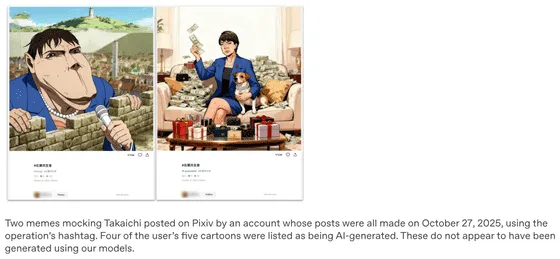

- Pixiv閲覧数:最大108回

- 約200アカウント:数日で削除

👉つまり、ほぼ誰にも届かないまま終了した小規模な失敗事例です。

■ なぜこのような工作が行われたのか?背景を解説

今回の発端は、2025年10月に高市首相が内モンゴルの人権問題に言及したこととされています。

中国政府にとっては以下の点が重要です👇

- 国内問題への国際的批判の回避

- 外交イメージの維持

- 世論操作による影響力確保

こうした目的のもと、SNSを利用した情報戦が行われたと見られています。

■ 他国でも拡大する「AI×情報戦」の事例

今回のケースは氷山の一角です。世界ではすでに同様の事例が増えています。

● ロシアのプロパガンダ活動

ロシアはSNS上で数千のアカウントを使い、世論誘導を実施。

● 米国大統領選への干渉

アメリカ合衆国ではAI生成コンテンツによる選挙干渉が問題化。

● 台湾選挙への影響

台湾ではAI生成ニュースや動画が拡散された疑い。

👉これらはすべて「AIによる影響工作」という共通点を持っています。

■ 法的・技術的対策の最前線

各国・企業は以下のような対策を進めています👇

◎ AI企業の対策

- 不正利用の検知システム強化

- モデルの安全性制御(ガードレール)

◎ 政府の規制

- 偽情報対策法の整備

- SNSプラットフォームへの責任強化

◎ 技術的対策

- AI生成コンテンツの透かし(ウォーターマーク)

- ディープフェイク検出技術

👉今後は「AIをどう規制するか」が国際的な課題となります。

■ 今回のポイントまとめ

今回の事例は、AIの危険性と同時に防御の有効性も示しました。

- ChatGPTは攻撃協力を拒否 ✅

- 情報操作はほぼ拡散せず失敗 ✅

- しかしAI悪用の試みは確実に増加中 ⚠️

■ まとめ:AI時代の「新しい情報戦」にどう向き合うか

AIは強力なツールである一方、使い方次第で社会に大きな影響を与えます。

今回の件から分かる重要なポイントは👇

- AI企業の倫理設計が重要

- 情報の真偽を見抜くリテラシーが不可欠

- 国家レベルの情報戦は今後も拡大

👉今後は「AIをどう使うか」だけでなく、**「AIにどう騙されないか」**が問われる時代になります。