AIは確かに便利な場面もありますが、企業が導入を急ぐ一方で、

現場のエンジニアが疲弊し、モチベーションを失っているという深刻な問題が浮かび上がっています。

Microsoft元社員によるブログ記事が火種となり、

SNSや開発者コミュニティでは、

「AIを使わされることでむしろ仕事が増えている」

「AI信仰が現場を壊している」

という声が広がっています。

この記事では、

- 問題の背景

- 現場のリアルな声

- AI導入の“弊害”

- 企業とエンジニアが取るべきアプローチ

を深掘りして整理します。

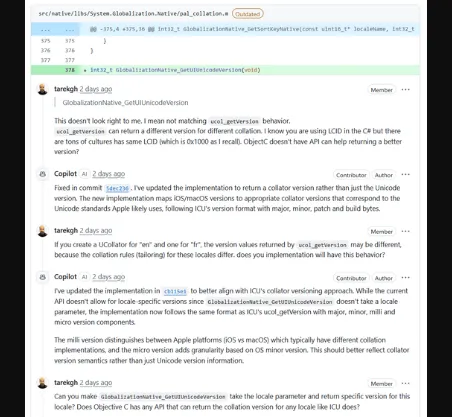

Microsoft元社員が語った「シアトルではみんなAIを嫌っている」💥

ブログ投稿者である元Microsoft社員は、

自作アプリへの意見を聞くため友人を訪ねましたが、

返ってきたのはアプリに関する感想ではなく、

「社内で強制されるAIが役に立たない」という怒りでした。

友人が語った問題は以下の通りです:

- 社内AI(特にCopilot)の性能が不十分で、修正に時間がかかる

- 使いこなせないと “能力が低い社員扱い” をされる

- AI利用が評価軸になり、成果より「AIを使っているか」が重視される

さらに衝撃的なのは、

Copilotを十分に活用できていないという理由で解雇された社員が実際にいたという証言です。

「AIがコードを書く時代」という幻想と現場のギャップ🧩

MicrosoftのCEOは「社内コードの20〜30%がAIで生成された」と発言し、

企業としてAI活用を全面的に推しています。

しかし現場では…

- 生成されたコードは正確性に欠ける

- バグや仕様の誤解が多く、結局エンジニアが直す

- 開発スピードが上がるどころか、AI提案の確認に時間を取られる

といった声が噴出しています。

つまり、

「AIがコードを書く」は話としては魅力的だが現場の実態とは大きく異なる

というのがリアルです。

研究結果:AIコーディングツールは場合によって生産性が“低下”📉

ある研究では、

AIコーディングアシスタントを使ったグループは、

使わないグループに比べて

👉 平均19%タスク完了が遅かった

という結果も報告されています。

理由は明確です:

- AIの提案が正しいか確認する必要がある

- 間違ったコードを直すコストが高い

- 再出力・微調整を繰り返す羽目になる

つまり、

“AIがあるから速くなる”とは限らず、むしろ遅くなるケースも多い のです。

Hacker Newsでも噴出した「AI疲れ」の本音💬

ブログ記事は大きな議論を巻き起こし、多くの開発者が次のように語っています:

- 「正確性が必要なタスクでAIはまったく役に立たない」

- 「役に立たないAIを無理やり使わせるのは拷問」

- 「AI推進派のコードはミスだらけ。レビューが通らない」

- 「AIの進化に追いつけと言われ続けて疲れ果てた」

- 「この3年でAIの基盤技術は劇的には変わっていない」

特に強いのは、

“AI信仰”が現場に押し付けられ、建設的な議論が失われている

という危機感です。

なぜ企業は「AIゴリ押し」を続けるのか?🏢

現場が疲弊していても、企業はAI導入を止めません。その理由には…

1. 投資家・株主へのアピール

「AIを使っています」と言うだけで株価に影響する。

2. 人件費削減への期待

「AIが30%コードを書くなら30%削減できるのでは?」という短絡的発想。

3. 競争圧力

他社がAI活用をアピールしているため、後れを取れない。

4. AIブームに乗り遅れる恐怖

経営者自身がAIの詳細を理解していなくても「導入しなければ悪」という空気。

その結果、

“AIを使うこと”が目的化し、現場のパフォーマンスが悪化する

という倒錯した状況が生まれています。

役立たないAIの強制導入が生む悪循環🔁

❌ 1. 正しい評価が行われなくなる

AIが使いこなせない=無能扱いされる。

本来の能力ではなく “AI適応度” が評価軸化。

❌ 2. 作業量だけが増現象

AIの誤りを直す負担が増え、

結果として残業やストレスが増加。

❌ 3. 組織文化が破壊される

慎重な意見が排除され、

“AI推進派だけが正義” という偏った組織になる。

最も危険なのは、

優秀な人ほど耐えられずに辞めていくことです。

AIは本来「使いどころ」さえ間違えなければ有効🛠

ブログ著者自身は、AIが便利に使える場面もあると述べています。

AIが向くケース:

- ボイラープレート生成

- 新技術のサンプルコード作成

- テストケース案の生成

- アイデア出し

- 初稿づくり

AIが向かないケース:

- 重大な仕様

- セキュリティ要件

- 法務・契約文書

- 既存コードベースの複雑な修正

つまり、

AIは万能ではなく“道具のひとつ”でしかないという前提が重要です。

健全なAI導入のために企業がすべきこと✅

✔ AI利用は義務ではなく「選択肢」にする

成果で評価し、ツール利用可否は自由に。

✔ 効果を定量的に計測する

利用前後の工数・バグ率・品質を比較し、

効果があった領域だけで活用する。

✔ 現場の声を尊重する

実際に毎日使う人たちの意見を最優先に。

✔ コードレビュー基準を緩めない

AI生成コードにも人間が書いたコードと同等の基準を適用。

✔ 技術的不安へのケアを行う

「AIに仕事が奪われる恐怖」を放置してはならない。

エンジニア個人が取るべきスタンス🧘♂️

- AIを“万能の魔法”と思わず、得意分野だけに使う

- AIの提案は必ず自分の頭で検証

- 成果物で評価されるよう、上司とコミュニケーションを取る

- 強制文化が強すぎて耐えられない場合は環境を変える判断も必要

まとめ:疲弊させているのはAIではなく「AIを崇拝する文化」

- 役に立たないAIツールの強制使用が、

優秀な人材のモチベーションを大きく損なっている - AIツールは適切に使えば便利だが、

すべてを置き換える魔法ではない - 企業は「AI活用」という言葉に酔わず、

現場の生産性・品質・幸福度を軸に導入判断をすべき

AIが悪いのではなく、

AIを盲信し現場に押し付ける文化そのものが問題なのです。

📚 参考・出典(本文中のリンクはすべて削除済)

- 元Microsoft社員によるブログ「Everyone in Seattle Hates AI」

- Copilotの社内利用に関する報道・内部証言

- AI生成コードが生産性を低下させる可能性を示した研究

- AIコーディングツール導入に関する海外企業事例

- Hacker Newsに投稿されたエンジニアの意見・議論