人間にとって「これはネコだ」と認識するのは一瞬のことですが、

コンピューターにとってネコを見分けることは簡単ではありません。

角度・光・毛色・背景が違っても「ネコ」と判断できる──

この能力を支えているのが、AI(人工知能)の中核技術であるニューラルネットワークです。

科学メディア「Quanta Magazine」は、AIがどのようにネコを識別しているのかを、

「三角形の領土」と「四角の国」というユニークな例で解説しています。

🔗 How Can AI ID a Cat? An Illustrated Guide. | Quanta Magazine

🧠 ニューラルネットワークとは?

ニューラルネットワークは、生物の脳の仕組みを模倣した数学的モデルです。

このモデルを使って、AIは「分類タスク」と呼ばれる処理を行います。

分類タスクとは──

「与えられたデータがどのカテゴリに属するかを判断すること」

たとえば画像が「ネコ」なのか「ネコ以外」なのかを判定するのが、その代表的な例です。

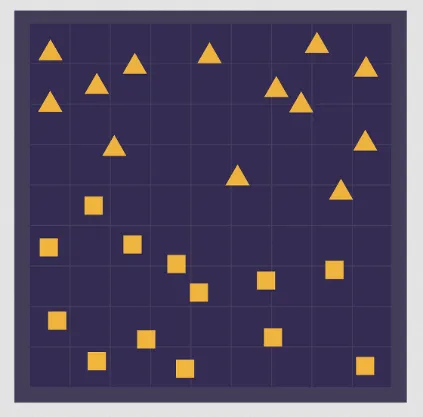

Quanta Magazineでは、この仕組みを理解するために、

「Triangle Territory(三角形の領土)」と「Square State(四角の国)」という

架空の国を使って説明しています。

🗺️ 仮想の“国境線”を引く:AIの分類の基本原理

もし、緯度と経度のような座標データを入力として与えられたとき、

AIは「その点がどちらの国にあるのか」を判断する必要があります。

しかしAIは地図を持っていません。

あるのは「この点は三角形の領土」「この点は四角の国」というラベル付きデータだけです。

AIはそれらの情報をもとに、

両国を分ける「境界線(decision boundary)」を自動で引くよう学習します。

このとき使われるのが、AIの最小単位である**人工ニューロン(perceptron)**です。

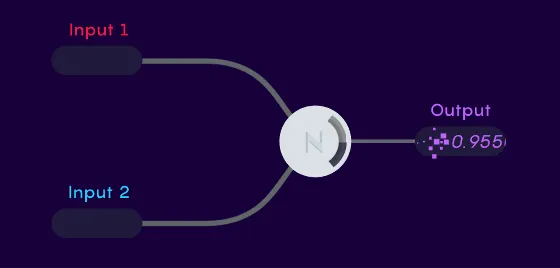

未知の点を分類する「分類器システム」を構築するには、まず境界線を引く必要があります。ニューラルネットワークの構成要素である人工ニューロンは、複数の数値を入力すると1つの数値を出力する数学関数です。

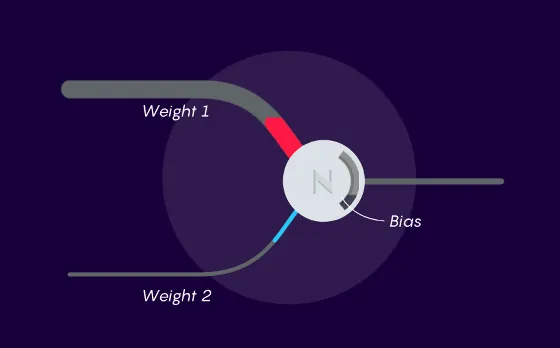

出力値は常に「0」か「1」どちらかに近い値となり、パラメータと呼ばれる別の数値と入力値の組み合わせによって決定されます。たとえば2つの入力を持つ人工ニューロンには、入力値が出力にどの程度影響するのかを示す「weight(重み)」というパラメータと、出力値の全体的な優先順位を決定する「Bias(バイアス)」というパラメータが存在します。入力が2つあるので重みは2つ、バイアスは1つで、パラメータは合計で3つあります。

以下の3つの図は、それぞれ異なるパラメータを持つ人工ニューロンが、どのような境界線を引くのかを示したもの。これらの図では境界線はいずれも直線となっており、パラメータによって直線の位置と角度が決まります。

⚙️ 人工ニューロンとは?重みとバイアスの役割

人工ニューロンは、複数の数値を入力して1つの数値を出力する関数です。

ここで重要なのが、次の2種類のパラメータです。

- 🧩 Weight(重み):各入力がどの程度出力に影響を与えるかを決定

- ⚖️ Bias(バイアス):出力全体の調整を行う基準値

たとえば、2つの入力を持つニューロンなら「重み×2 + バイアス×1=合計3つのパラメータ」を持ちます。

この組み合わせによって、AIが描く「境界線」の傾きや位置が決まります。

AIは、これらのパラメータを調整して、

「三角形の領土」と「四角の国」を最も正確に分けられるように境界線を更新していきます。

🔄 学習のプロセス:間違いから境界線を修正していく

AIが正しい判断をできるようになるまでの過程を**トレーニング(学習)**と呼びます。

最初は重みやバイアスがランダムに設定されています。

AIは「仮の境界線」で分類を行い、その結果と正解データを比較します。

誤差が生じた場合、AIはその差をもとにパラメータを修正。

これを繰り返すことで、少しずつ**正しい国境線(分類境界)**へと近づいていきます。

この仕組みを支えているのが、数学的な最適化手法である

**勾配降下法(Gradient Descent)**と呼ばれるアルゴリズムです。

🧩 ネコ識別のような複雑な問題には“多層構造”が必要

「三角形の領土と四角の国」のような単純な分類は、

1つの人工ニューロン(単層)でも可能です。

しかし、「ネコを見分ける」となると話は別。

画像は数千~数百万のピクセルから構成され、毛並み・表情・背景が多様です。

こうした複雑な特徴を学ぶために使われるのが、

**多層構造のニューラルネットワーク(Deep Neural Network)**です。

🧱 層が積み重なることで「抽象的特徴」を学ぶ

ニューラルネットワークは、複数の層(Layer)から構成されます。

それぞれの層は以下のような役割を持っています。

- 🖼️ 入力層:画像データ(ピクセル値など)を受け取る

- ⚙️ 中間層(隠れ層):輪郭や模様などの特徴を抽出

- 🧠 出力層:「ネコ」「ネコではない」などの結果を出す

各層の出力が次の層への入力となり、

レイヤーを通過するごとにより抽象的で高次な特徴を学びます。

例えば…

- 最初の層:線やエッジを検出

- 次の層:耳や目の形状を認識

- 最終層:「ネコ」という概念として統合

この階層構造こそが、人間の感覚に近い「認識」をAIが行える理由です。

🧮 入力の次元が増えると、AIの“理解力”も向上

ニューラルネットワークは、入力データの数に制限がありません。

たとえば次のようなデータも扱えます。

- 画像のピクセル(例:50×50=2,500個)

- 音声の波形データ

- 3Dオブジェクトの空間座標

- 動画のフレームデータ

入力が増えるほどAIの「視点」は広がり、

ネコの輪郭・毛並み・目の形・動きなどを総合的に理解できるようになります。

Quanta Magazineは、「十分なデータポイントがあれば、AIはネコとそれ以外を正確に見分けることができる」と説明しています。

🐾 まとめ:AIは“数学の目”でネコを見ている

AIがネコを識別できるのは、

数百万のピクセルを「数学的特徴」に変換し、

その中に潜む“ネコらしさ”の境界線を発見しているからです。

🧠 つまり、AIは「ネコの耳」や「しっぽ」を理解しているわけではなく、

データの中に現れる数値的なパターンを捉えているのです。

人間の「直感的理解」とは違うアプローチですが、

AIは数式の世界で確かに“ネコ”を見ています。